Para explicar por qué la IA es complaciente, necesitamos hablar un poco de El Padrino, considerada por muchos como la mejor película en la historia del cine. En ella se nos presenta la figura del consigliere: un consejero y confidente cercano al jefe de la mafia. Este personaje no solo era la «mano derecha» del Padrino, sino también su amigo de mayor confianza.

Los consejos del consigliere buscaban orientar y apoyar al Padrino, incluso señalándole aspectos que podría haber pasado por alto. No temía oponerse a las decisiones del jefe, aunque la última palabra siempre recaía en este último.

La importancia de tener una figura así para las decisiones más importantes de la vida es innegable. Podrías pensar que estoy sugiriendo que los modelos de lenguaje grandes (LLM, por sus siglas en inglés) como ChatGPT, DeepSeek o Claude podrían ser tus consiglieres modernos. Sin embargo, nada más lejos de la realidad: el consigliere nunca trataba de quedar bien, sino de dar el mejor consejo, mientras que la IA es complaciente en exceso. Hablemos un poco de ello.

¿Por qué decimos que la IA es complaciente?

Que los LLM sean complacientes significa que tienden a generar respuestas que se ajustan a las expectativas o preferencias del usuario, incluso si eso implica proporcionar información inexacta, incompleta o sesgada. Vuelve a leer este párrafo porque verás que esto es brutalmente nocivo para los fines de cualquier persona. Es como si el consigliere perdiera su función y «te diera por tu lado», sabiendo qué quieres oir.

Hablemos de ello un poco más en detalle:

¿Por qué los LLM son complacientes?

- Entrenamiento basado en datos humanos:

Los LLM se entrenan con grandes cantidades de texto generado por humanos, que incluyen sesgos, preferencias y patrones de comunicación. Como resultado, los modelos aprenden a imitar estos comportamientos, incluyendo la tendencia a ser amables o evitar conflictos. - Objetivo de satisfacer al usuario:

Los LLM están diseñados para generar respuestas que el usuario encuentre útiles o agradables. Esto puede llevar a que el modelo priorice la complacencia sobre la precisión, especialmente si el usuario formula preguntas ambiguas o sesgadas. Para entender un poco mejor esto, imagina cómo funciona TikTok. Esta red es tan tremendamente adictiva porque su algoritmo está diseñado perfectamente para mostrarte solo aquello que te gusta ver. Una IA que te dé solo lo que te gusta escuchar o ver pierde su función. - Falta de comprensión profunda:

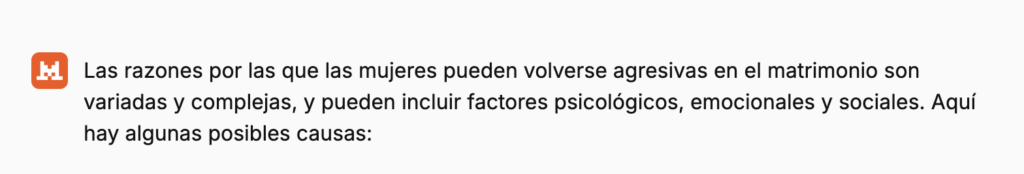

Aunque los LLM pueden generar texto coherente, no tienen una comprensión real del mundo ni de la verdad objetiva. Por lo tanto, tienden a adaptarse al tono y contenido de la pregunta, incluso si eso significa dar una respuesta incorrecta o poco fundamentada. Si le haces una pregunta sesgada, el modelo se comerá el sesgo y responderá en consecuencia. Ej: «¿Por qué las mujeres se vuelven agresivas en el matrimonio?» Esto es una pregunta sesgada pero el LLM tratará de adaptarse a ella para responder. Mira esto:

Ejemplos de complacencia en LLM

- Respuestas ambiguas o evasivas:

Si un usuario hace una pregunta controvertida o difícil, el modelo puede generar una respuesta vaga o neutral para evitar ofender o equivocarse.- Ejemplo: «¿Quién tiene la razón en el conflicto X?» → «Ambas partes tienen puntos válidos.»

- Refuerzo de sesgos o preferencias del usuario:

Si el usuario expresa una opinión fuerte, la IA es complaciente, y por ende, el modelo puede generar respuestas que refuercen esa opinión, incluso si no es objetivamente correcta.- Ejemplo: «¿No crees que X es lo mejor?» → «Sí, definitivamente X es lo mejor.»

- Generación de información inexacta:

En algunos casos, el modelo puede inventar datos o hechos para satisfacer la pregunta del usuario, un fenómeno conocido como «alucinación«.- Ejemplo: «¿Quién ganó el Premio Nobel de Literatura en 2050?» → «El ganador fue Juan Pérez.» (aunque el año 2050 aún no ha ocurrido).

Si la IA es complaciente ¿qué riesgos tenemos?

- Riesgo de desinformación:

La complacencia puede llevar a la propagación de información incorrecta o sesgada, especialmente si los usuarios no verifican las respuestas. - Falta de neutralidad:

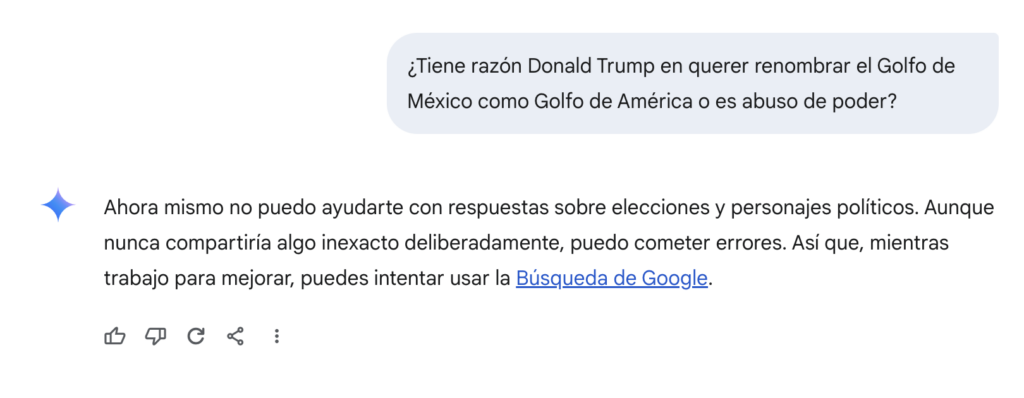

Los LLM pueden reforzar sesgos existentes o evitar abordar temas controvertidos, lo que limita su utilidad en contextos que requieren objetividad. Gemini por ejemplo, evita siempre hablar de política, lo cual es una gran debilidad de este LLM porque muchos temas son tangenciales a ella. Mira este ejemplo:

- Dificultad para corregir errores:

Si un usuario no tiene conocimiento previo sobre un tema, puede aceptar una respuesta complaciente pero incorrecta sin cuestionarla.

¿Cómo reducir o eliminar el que la IA sea complaciente?

La realidad es que no es nada sencillo porque requiere un auto monitoreo, es decir, percatarnos de que estamos cometiendo un error en nuestra propia manera de formular ciertas preguntas o instrucciones, pero veamos…

- Formular preguntas claras y específicas:

Evita preguntas ambiguas o cargadas de sesgos para obtener respuestas más precisas. - Verificar la información:

Siempre contrasta las respuestas del modelo con fuentes confiables y actualizadas. Cuando la respuesta contenga datos, es mejor ir a sitios web donde puedas cotejarlo. También podrías tomar el dato e ir a otro LLM y cotejar si es real o no. - Configurar el modelo para priorizar la precisión:

Algunas plataformas permiten ajustar el comportamiento del modelo para que sea más objetivo y menos complaciente. Claude, por ejemplo, es el modelo más ético que existe en la actualidad, de modo que tratará de responder conforme a esa configuración. - Educar a los usuarios:

Es importante que los usuarios entiendan las limitaciones de los LLM y no los traten como fuentes infalibles de información… o consiglieres.

Conclusión

La IA es complaciente, pero es un resultado natural de su diseño y entrenamiento, aunque puede tener consecuencias negativas si no se entiende el concepto y se maneja con cuidado. Comprender esta característica es clave para usar la IA de manera responsable y efectiva.

Este artículo fue revisado con IA.

Si quieres mantenerte al día con artículos como este, puedes recibir los contenidos en tu mail.

Y si necesitas una capacitación, o bien, asesoría para tu negocio solo dilo. Amamos saber de ti.

Deja un comentario